داخلی

»کتابخانه و کتابداری

پژوهش استاد ایرانی؛ سوءگیریهای جنسیتی و نژادی در گوگل ویژن

به گزارش لیزنا، این مقاله با عنوان “Who is a scientist? Gender and racial biases in Google Vision AI” به قلم دکتر احسان محمدی، استاد ایرانی دانشگاه کارولینای جنوبی (ایالات متحده) به همراه ییزهو کای، علامیر نوین، والری ورا و احسان سلطانیمحمدی منتشر شده است.

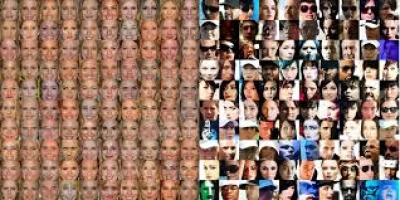

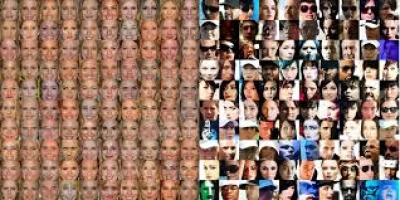

پژوهش انجامشده با بررسی ۱۶۰۰ تصویر متنوع از دانشمندان نشان میدهد سرویس Google Cloud Vision AI در شناسایی چهرههای علمی، دچار سوگیریهای ضمنی است. بر اساس نتایج، افراد سیاهپوست و اسپانیاییتبار کمتر از همتایان سفیدپوست و آسیایی به عنوان "دانشمند" شناسایی شدهاند. همچنین، زنان در مقایسه با مردان به طور چشمگیری کمتر به عنوان دانشمند معرفی شدهاند.

این تحقیق تأکید میکند که تبعیضها در نقطه تقاطع نژاد و جنسیت شدت بیشتری پیدا میکند؛ به طوری که زنان رنگینپوست کمترین شانس دیدهشدن به عنوان دانشمند را در نتایج این هوش مصنوعی دارند.

نویسندگان مقاله هشدار میدهند که در صورت عدم نظارت و اصلاح چنین الگوریتمهایی، پیامدهای تدریجی و نامحسوسی در زندگی واقعی شکل خواهد گرفت که میتواند به بازتولید تبعیضهای اجتماعی بینجامد. آنان بر ضرورت توجه به مقولههایی چون انصاف الگوریتمی (Algorithmic Fairness) و رفع تبعیضهای نژادی و جنسیتی در سامانههای هوش مصنوعی برای حفظ اعتماد عمومی تأکید کردهاند.

۱. از توهین به افراد، قومیتها و نژادها خودداری کرده و از تمسخر دیگران بپرهیزید و از اتهامزنی به دیگران خودداری نمائید.

۲.از آنجا که پیامها با نام شما منتشر خواهد شد، بهتر است با ارسال نام واقعی و ایمیل خود لیزنا را در شکل دهی بهتر بحث یاری نمایید.

۳. از به کار بردن نام افراد (حقیقی یا حقوقی)، سازمانها، نهادهای عمومی و خصوصی خودداری فرمائید.

۴. از ارسال پیام های تکراری که دیگر مخاطبان آن را ارسال کرده اند خودداری نمائید.

۵. حتی الامکان از ارسال مطالب با زبانی غیر از فارسی خودداری نمائید.